|

|

|

|

|

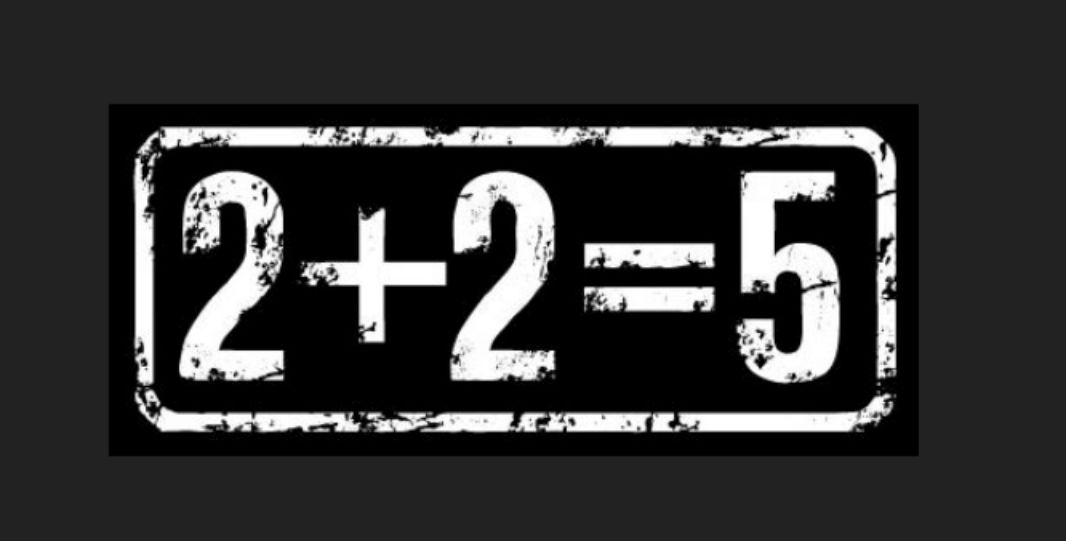

Tenemos la percepción de que la inteligencia artificial no es una buena aliada de la verdad. Un estudio de la Universidad de Georgetown (EEUU) confirma esa percepción.

|

Nos adentramos entusiasmados en un mundo en el que todo se puede inventar o manipular, incluso la geografía.

|

|

Máquinas de desinformación masiva

|

|

Los sistemas de generación de lenguaje natural como GPT-3 son más eficientes para desinformar que para generar textos veraces.

|

Esta es una de las conclusiones a la que ha llegado un equipo de investigadores del Center for Security and Emerging Technology (CSET) de la Universidad de Georgetown (EEUU) que acaba de publicar un trabajo titulado Verdad, mentiras y automatización en el que analiza cómo GPT-3 es altamente eficaz mediante seis maneras de desinformar: replicando mensajes, creando nuevas informaciones, manipulando textos veraces, buscando puntos débiles de la argumentación contraria, polarizando e incluso convenciendo a no convencidos.

|

|

Si las capacidades de los sistemas de procesamiento de lenguaje natural aumentan en la línea de lo que hoy están haciendo pueden convertirse en eficaces máquinas de desinformación masiva.

|

|

|

|

|

|

|

|

|

|

Saber +

Cientos de científicos de todo el mundo están trabajando juntos para comprender antes de que sea demasiado tarde una de las tecnologías emergentes más poderosas, el procesamiento de lenguaje natural . Karen Hao en Technology Review

|

La IA puede modificar el comportamiento ético de las personas

Un estudio publicado por investigadores de la Universidad de Ámsterdam, el Instituto Max Planck, la Escuela de Administración Otto Beisheim y la Universidad de Colonia ha analizado hasta qué punto los consejos generados por sistemas de IA pueden llevar a las personas a cruzar líneas morales. En una encuesta a gran escala que aprovechó el modelo de lenguaje GPT-2 de OpenAI, los investigadores encontraron que los consejos de la IA pueden "corromper" a las personas incluso cuando saben que la fuente de los consejos es un sistema automatizado. Venturebeat

|

La geografía también se puede inventar

|

Un profesor de la Universidad de Washington ha estado experimentando en el empleo de técnicas similares a los llamados deepfakes para alterar imágenes de satélite de varias ciudades como Pekín y Seattle. El resultado es altamente convincente. Las imágenes satelitales modificadas podrían difundirse en las redes sociales y diseminar información visual errónea aparentemente real y engañar a gobiernos y ciudadanos. Whasington.edu y Wired

|

|

|

|

|

|

Este artículo, o uno parecido, podría haber sido escrito por una máquina. No es así. De momento.

|

|

Así funciona el sistema GPT-3 de creación automática de textos.

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

Ética digital

|

|

Sabemos lo que hiciste durante el confinamiento. Vídeo

Renunciamos a nuestra privacidad para luchar contra la Covid-19, ¿podemos recuperarla? Una película de 18 minutos producida por el diario Finantial Times recrea la escena de un interrogatorio que muestra cómo la lucha contra el virus ha puesto de manifiesto la tensión entre la necesidad de datos para evitar los contagios y el derecho a la privacidad y la justicia. VER

|

Las máquinas malinterpretan las emociones humanas

|

Los sistemas automatizados de detección de emociones se están implementando en ámbitos como el de la selección de personal. Aunque no hay pruebas convincentes de que las expresiones faciales revelen los sentimientos de una persona, las grandes empresas de tecnología quieren que creamos lo contrario. Artículo de Kate Crawford, autora de Atlas of AI, en The Atlantic

|

China prueba el reconocimiento de emociones en la población uigur. BBC

|

Denuncia contra Clearview AI, el mayor recopilador de rostros

Privacy International, el Centro Hermes para la Transparencia y los Derechos Humanos Digitales, Homo Digitalis y NOYB, el Centro Europeo de Derechos Digitales, han presentado una serie de denuncias contra Clearview AI. La empresa de reconocimiento facial afirma tener “la base de datos más grande con más de 3 mil millones de imágenes faciales”. Las denuncias se enviaron a los reguladores de protección de datos de Francia, Austria, Italia, Grecia y el Reino Unido. Privacy International

|

Más datos no mejoran la IA

Las personas no toman mejores decisiones cuando disponen de más datos, entonces, ¿por qué asumimos que la IA lo hará? Las decisiones no se toman sólo en función de la precisión de los datos sino que están fuertemente influidas por las normas y expectativas tanto de los usuarios como de las organizaciones que las toman. Onezero

|

El juego de los términos y condiciones

Nuevo mini juego onlíne que parodia las estrategias que utilizan los sitios web para obtener tus datos. El objetivo del juego de Términos y Condiciones es escapar sin entregar tus datos. Se inspira en darkpatterns.org, la web que identifica los sitios y aplicaciones que te obligan a hacer cosas que no pretendías. Termsandconditions.game

|

|

|

|

|

|

Leer +

|

|

|

Anna Wiener desvela la cara oscura de Silicon Valley –los falsos ideales, las interminables jornadas, el corporativismo alienante, la misoginia endémica–, y recorre la fina línea entre utopía y distopía en la que operan unos emporios tecnológicos que ponen en peligro nuestras sociedades: desde el inexorable control que las apps y las redes ejercen sobre nosotros, hasta la brutal desigualdad que ha desfigurado las señas de identidad de su epicentro, la ciudad de San Francisco. Libros del Asteroide

|

|

|

|

|

|

|

|

Documentos

- The Case for Better Governance of Children’s Data: A Manifesto. Unicef

|

- The Unseen Teen.The Challenges of Building Healthy Tech for Young People. Data&Society

|

|

|

|

|

|

La frase

|

|

Para engañar a la inteligencia artificial de selección de personal basta con poner un fondo de libros. Otra muestra de que la IA que vende análisis de personalidad/emociones es humo

|

|

|

|

|

|

|

|

|