A principios de junio un simposio internacional sobre Confianza y Ética en los Vehículos Autónomos (STEAV) celebrado en Cambridge, Massachussets, dejó abiertas las incertidumbres sobre el despliegue de esta tecnología.

David Weinberger, del Berkman Klein Center de la Universidad de Harvard, nos ofrece un resumen.

A veces la claridad significa aceptar la complejidad. Esta podría ser una de las conclusiones del Simposio sobre Confianza y Ética de los Vehículos Autónomos (STEAV). Una segunda conclusión: los vehículos autónomos (automóviles y camiones sin conductor) van a transformar prácticamente todos los aspectos de nuestro mundo.

El simposio reunió a más de setenta expertos de todo el mundo en campos tan diversos como la informática, el derecho, la política, la ética, la planificación urbana y la industria de los seguros, para reflexionar sobre cómo podemos dar forma al despliegue de los vehículos autónomos (AV) para que nuestro mundo sea más habitable y justo. El evento, inaugurado por Joi Ito , director del MIT Media Lab , fue organizado por el Berkman Klein Center de la Universidad de Harvard , el MIT Media Lab y el Instituto de Estudios Avanzados de Toulouse, como parte del proyecto Ethics and Governance of AI .

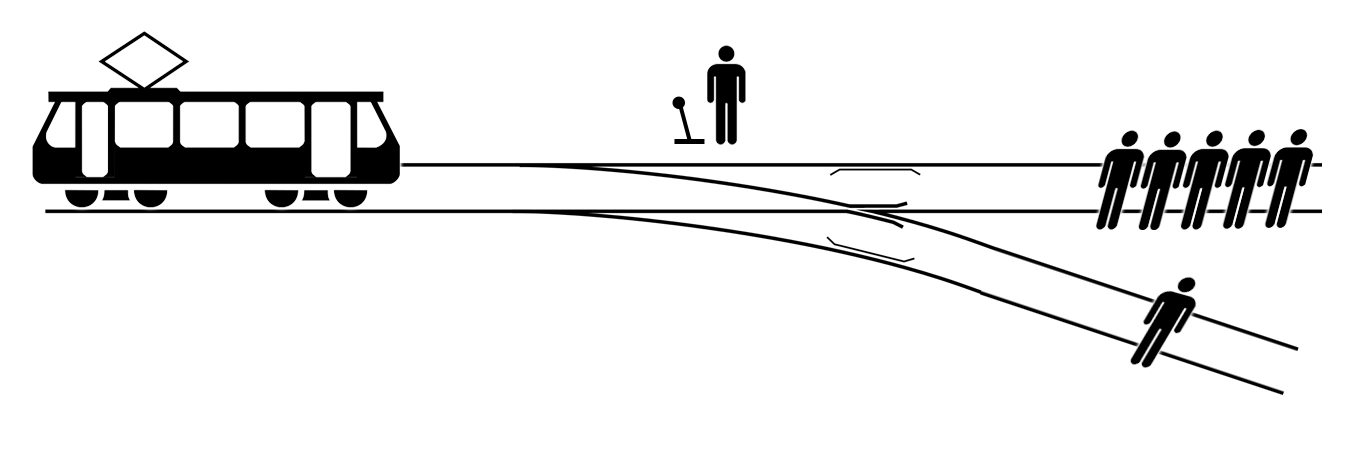

En el transcurso de un día y medio se evidenció que problemas aparentemente simples resultan ser no sólo complicados, sino también imprecisos. Una complicación que supera el canónico ejemplo del dilema del tranvía que, según la presentación inicial de Iyad Rahwan del Media Lab, genera resultados muy distintos en función de las diferentes culturas, como evidencian los cuarenta millones de registros obtenidos en el proyecto Moral Machine.

Patrick Lin, profesor de filosofía de la Universidad Politécnica de California (Cal Poly), argumentó que el dilema del tranvía es un ejercicio mental comparable a un experimento de laboratorio: un caso simplificado y limitado que nos permite ver los efectos de las variables. Una simplificación artificial que, sin embargo, da lugar a una discusión interminable. (Más información sobre Patrick Lin aquí.)

Sin respuestas simples a ninguna de las preguntas sobre el rol y la gobernanza de los AV.

No sólo no estamos de acuerdo sobre cuán seguros deberán ser los AV antes de permitir su despliegue, sino que “cuanto más precisión queramos tener sobre la seguridad de una tecnología, más riesgo tenemos que aceptar al implementarla”, en palabras de Laura Fraade-Blanar, de la Corporación RAND. Necesitaríamos realizar cinco mil millones de millas de pruebas en carretera para obtener la confianza estadística de que los AV podrían tener una tasa de accidentes mortales un veinte por ciento inferior a la de los vehículos conducidos por humanos.

Las pruebas realizadas por Google en febrero de 2018 registraron un milésima parte de esa cifra. Conducir cinco mil AVs, doce mil millas cada uno, con un total de sesenta millones de millas registradas, podría darnos información estadísticamente significativa sobre si la tasa de accidentes de los AV es, al menos, un diez por ciento inferior a la de los vehículos conducidos por humanos, pero no arrojaría ninguna idea significativa sobre la diferencia en relación a accidentes mortales, a menos que esa diferencia fuera de más del ochenta por ciento.

Los coches autónomos lo registran todo. ¿Con qué los comparamos?

Pero todo es aún más complejo. Para comparar los riesgos y beneficios planteados por los AVs versus los automóviles tradicionales, sería útil contar con datos equivalentes. Los AV lo registran casi todo: generan hasta un gigabyte de datos por minuto. Sabremos cada vez que pasen por encima de un bordillo o se desvíen para evitar un obstáculo. Pero los humanos, por lo general, no informan sobre incidentes tan pequeños o sobre daños demasiado menores como para que valga la pena alertar a las compañías de seguros. Y entonces, ¿con qué comparamos los AVs? ¿Con todos los automóviles que circulan, incluidos los Corvairs de treinta años que están en las últimas, o con los automóviles nuevos en el rango de precios de un AV?

La comparación entre AVs y automóviles tradicionales no se puede resolver sin tomar decisiones no triviales y no obvias sobre lo que entendemos como seguro. Sin esa información, los encargados de formular propuestas políticas y los reguladores tendrán dificultades para saber cuándo implantar el despliegue de los AV y cómo evaluar su funcionamiento.

Conmueve más un accidente causado por una máquina que por una persona

Después, esas decisiones tendrán que ser vendidas a los ciudadanos. Según datos presentados, el 47 por ciento de los norteamericanos ya han decidido que los AV no serán seguros. Chaiwoo Lee del MIT Age Lab informó que los hombres son más propensos que las mujeres a aceptar los AV como una forma segura de transporte, mientras que las personas mayores se sienten menos cómodos con coches que conducen por su cuenta.

También señaló que la aceptación de los AV puede depender de si estarán en nuestras calles como vehículos propiedad de individuos o como una flota de coches de alquiler, como Uber o Lyft. También recordó qué tan drásticamente puede verse alterada la percepción de riesgo del público en función de los acontecimientos: 40,000 personas murieron en accidentes de tráfico en 2017 en EE. UU., pero una sola muerte altamente publicitada en un AV podría volver al público contra el programa, quizás en parte porque, como dijo uno de los panelistas, citando a Kate Darling : “… las personas se sentirán mucho más conmovidas por un accidente causado por una máquina que por una persona”.

Aunque evitar muertes de tráfico fue uno de los primeros temas en la lista de prioridades de todos los que participaron en la conferencia, no fue el único. Noah Goodall del Consejo de Investigación de Transporte de Virginia sugirió que la muerte reciente de un ciclista en un choque con un AV de Uber en Arizona podría ser la consecuencia de cómo fueron diseñadas las preferencias de seguridad: si un AV frena por cada falso positivo generado por su sistema de detección de colisiones, el viaje será innecesariamente brusco e incómodo, lo qual supone un incentivo para cambiar seguridad por comodidad.

Las diferencias culturales impedirán un código ético universal

En la conferencia también participó Christoph Lütge de la Technische Universität München que habló del proceso por el cual el gobierno alemán ha redactado un código ético para implantar los AV [ pdf ] que está generando consenso a nivel internacional. El documento proporciona un completo ordenamiento de valores, incluyendo la prevención del daño a los humanos por encima de la protección de las propiedades y los animales, valorando todas las vidas humanas por igual independientemente de categorías como edad y raza, y priorizando la protección de las vidas humanas.

Muchos países siguen con atención el código ético alemán, pero es poco probable que se alcance un acuerdo universal para implanarlo, aunque sólo sea por las diferencias culturales que ha documentado Moral Machine, como las actitudes hacia los ancianos e incluso hacia los gatos y los perros. Esto condujo a una discusión recurrente entre los participantes sobre cómo las naciones e incluso las ciudades podrían tratar de armonizar sus diferentes códigos éticos basados en sus valores locales. “¿Vamos a tener reglas de conducción por la izquierda y por la derecha, pero uniformes, esta vez, para la ética?”, preguntó un participante.

Aida Joaquin Acosta, investigadora del Berkman Klein Center y colaboradora del gobierno español, tenía más esperanzas. Señaló que las políticas gubernamentales pueden dar forma a la tecnología y describió algunas de las iniciativas europeas serias y bien financiadas que podrían conseguir un amplio acuerdo y armonización de las políticas relativas a los AV.

Los AV’s también causaran accidentes, reducirán empleo y pueden aumentar el consumo energético

En una conferencia animada con debate y desacuerdos, todos coincidieron en al menos un punto: los AV tendrán algunas desventajas. Incluso si los AV eliminan por completo el 93 por ciento de los accidentes causados por error humano, aún habrá un siete por ciento de accidentes. Por lo tanto, es muy probable que los AV estén implicados en accidentes mortales. Además, una implantación general de los AV podría dejar sin trabajo a millones de conductores de camiones y taxistas con un impacto desproporcionado en las poblaciones que tradicionalmente han aprovechado esas oportunidades de empleo.

Los AV también pueden degradar seriamente la vida de la ciudad (imagine coches sin conductor corriendo por sus calles a 150 mph), exacerbar las disparidades entre las poblaciones urbanas y rurales, y magnificar la desigualdad de acceso al transporte en las partes más pobres de la ciudad. Si bien muchos esperan que los AV eléctricos reduzcan el impacto ambiental del transporte, algunos de los participantes en la conferencia expresaron su temor a que el fácil acceso a viajes de muy bajo coste podría aumentar las millas recorridas y contrarrestar el ahorro que aportaría un sistema totalmente eléctrico .

¿Quién tendrá acceso a la información?

Otra tema discutido ampliamente fue el de la privacidad. Lauren Smith, consejera política en el Future of Privacy Forum, dijo que nuestros automóviles son más parecidos a teléfonos inteligentes que a objetos mecánicos, y los AVs, aún más. Los automóviles actuales ya recopilan mucha información sobre nosotros, nuestros vehículos y nuestra conducción. Una flota de AVs puede recolectar mucho más y sus propietarios probablemente querrán monitorizar incluso los interiores para verificar su limpieza, efectos de vandalismo e incluso malos olores.

Es probable que nos acostumbremos a eso ya que, como señaló Smith, nuestras expectativas sobre la privacidad ya son más bajas cuando tomamos el transporte público que cuando viajamos en nuestro propio automóvil; los autobuses de muchos municipios tienen cámaras de vigilancia. Pero ni siquiera los AV privados pueden limitar su recopilación de datos al automóvil o su conductor. La información sobre pasajeros, peatones, condiciones de la carretera y otros vehículos en la carretera también se incluirá en estos sistemas. De hecho, algunos automóviles tradicionales están a punto de recibir un software de reconocimiento facial que advertirá cuando el conductor parece estar cansado. Smith planteó las preguntas cruciales: ¿Quién tendrá acceso a esta información? ¿Cómo deberá ser gestionada?

Los AV’s tomaran decisiones que no comprenderemos

La inexplicabilidad potencial de las “decisiones” de los AV también puede complicar enormemente su gobernanza. Estos vehículos se guiarán por el tipo de Inteligencia Artificial denominado “machine learning” cuyos resultados se basan en redes de datos que pueden incluir decenas de miles de variables, cada una conectada a muchas otras, y cada una con su propio peso que determina cuándo será tenida en cuenta. Esto es muy diferente a la forma habitual de programar un ordenador mediante un modelo relativamente simple de interacciones y reglas. Puede haber decisiones tomadas por estos sistemas que el cerebro humano simplemente no pueda comprender, especialmente si los AVs están capacitados para formar redes con otros AVs para que puedan desarrollar acciones que maximicen los beneficios elegidos al programarlos.

Sin embargo, Sandra Wachter , abogada e investigadora del Oxford Internet Institute, sugirió una forma de entender las decisiones de Inteligencia Artificial sin tener que rastrear los millones de conexiones de un sistema. Supongamos que se sospecha que el género puede haber jugado un papel determinante en el rechazo de un sistema de aprendizaje automático a una solicitud de préstamo. En lugar de tratar de distinguir la red de variables extremadamente compleja de Inteligencia Artificial aplicadas, ninguna de las cuales puede expresar directamente su género, Wachter sugiere que un investigador podría volver a enviar la solicitud con pequeños cambios para ver qué variables habrían oscilado la decisión a su favor. Tal procedimiento podría identificar los factores determinantes que habrían orientado la aplicación de Inteligencia Artificial utilizada. (Consulte este documento para obtener más información).

¿Primará el beneficio o los valores éticos?

Independientemente de cómo se resuelva, la cuestión de la “explicabilidad” afectará profundamente los procesos por los cuales los gobiernos y los reguladores tomarán decisiones. ¿El proceso se convertirá en una “tiranía de las estadísticas”, como sugirió un panelista? ¿ O, tal como lo sugirió un educador, los temas éticos pasarán a primer plano?. Jason Millar , profesor de filosofía en la Universidad de Stanford con experiencia en tecnología, realiza talleres de “design thinking” con equipos de ingeniería para ayudarles a crear tecnología y al mismo tiempo tener en cuenta los resultados éticos. Comienza replanteando la discusión en términos de valores humanos en lugar de principios éticos, y luego se piensa en cómo la tecnología puede lograr esos valores.

Este enfoque lo compartió también Kristopher Carter de la Oficina de Nueva Mecánica Urbana de la alcaldía de Boston. Carter argumentó que los valores humanos están incorporados a cada aspecto del diseño de la ciudad. “Damos forma a nuestras calles. Y luego ellas nos forman a nosotros”, dijo, parafraseando la cita de Winston Churchill sobre la construcción de edificios. Por ejemplo, algunas calles de Boston favorecen el tráfico de vehículos sobre el de peatones (semáforos demasiado largos, mala colocación de los cruces) lo cual involuntariamente fomenta el cruce peatonal desordenado. “¿Cómo queremos que los AVs prioricen a los peatones?”, preguntó.

También surgen problemas de imparcialidad: los algoritmos de aprendizaje automático de Amazon determinaron que toda el área de Boston sería aceptada para las entregas durante el mismo día del servicio Prime … excepto la parte más pobre de la ciudad. Carter usó este ejemplo para argumentar -no por primera vez en la conferencia- que una ética puramente basada en resultados es inadecuada, ya que los principios de equidad deberían tener prioridad sobre los beneficios prácticos.

Europa quiere una regulación previa; EEUU, analizar los efectos.

Todas estas dudas, y otras más, demuestran que la gobernanza de los AV es complicada, compleja e imposible de resolver a la perfección. Sin embargo, alguna institución o confluencia de fuerzas sociales tendrá que establecer las reglas para el despliegue de los AV y decidir sobre los mecanismos de rendición de cuentas por los daños que inevitablemente provocarán. Urs Gasser , Director Ejecutivo del Centro Berkman Klein, destacó una diferencia general en la forma en que los gobiernos europeos y los Estados Unidos abordan la gobernanza. Los europeos presentes en la conferencia parecían, en general, estar a favor de que los gobiernos promulguen de forma proactiva directrices y políticas éticas, mientras que Earl Weener , miembro de la Junta Nacional de Seguridad en el Transporte de EE. UU., tomó como modelo la gobernanza exitosa de la seguridad de las aerolíneas: aprender de los análisis forenses de los accidentes y formar una asociación voluntaria gobierno-industria similar a la del equipo de seguridad operacional de la aviación [ pdf ] que ha demostrado ser eficaz en la seguridad de los viajes en avión.

En general, el simposio STEAV mostró la profundidad del desafío que la Inteligencia Artificial plantea a nuestras ideas sobre responsabilidad y moralidad. Los debates, tradicionalmente difíciles, sobre los valores que colectivamente queremos apoyar, las concesiones que estamos dispuestos a hacer, y sobre quiénes somos responsables de los inevitables fracasos, se han complicado por el hecho de que estamos utilizando autómatas para actuar como representantes de nuestros procesos de toma de decisiones … y no siempre podemos entender cómo llegaron a sus conclusiones. Esto requiere una nueva forma de pensar no sólo sobre qué reglas y regulaciones queremos imponer a los AV, sino también sobre cómo priorizamos la ética y la responsabilidad.

La mejor alternativa es seguir produndizando el debate antes que resolverlo demasiado pronto

Janina Lohl de la Universidad de Viena analizó el grado en que un AV podría ser considerado responsable de sus actos al presentar un nuevo modelo que establece una “red de responsabilidad” con roles para los agentes, los actores y los objetos de las acciones. Que la Inteligencia Artificial que permite los AVs pueda llevarnos a revisar el mismo marco de responsabilidad en sí es una indicación de la profundidad del cambio que estamos viviendo.

Tal vez cuestiones como las discutidas en el simposio motiven discusiones más explícitas sobre la necesidad de equilibrar nuestros valores -seguridad versus velocidad, versus impacto ambiental, etc.- y comprometerse más con valores como la equidad y la no discriminación que no estamos dispuestos a comerciar a cambio de beneficios puramente pragmáticos. Tal vez debates como los iniciadas en STEAV conduzcan a decisiones claras sobre los valores que queremos que respalden los AVs y otros sistemas impulsados por la Inteligencia Artificial, así como las leyes, reglas, normas e incentivos de mercado más efectivos para lograr nuestra visión.

Los problemas no van a desaparecer. Quizás la única conclusión de STEAV fue que es mejor seguir profundizando en el debate antes que resolverlo demasiado pronto.

Más información sobre el proyecto de Ética y Gobernabilidad de la Inteligencia Artificial en el sitio web de BKC.