Avanza la implantación de sistemas automatizados de toma de decisiones en Europa. Los riesgos superan a los beneficios, según el informe Automating Society 2020 que ha presentado su edición en español.

.

“No estamos automatizando la sociedad. Ya la hemos automatizado y finalmente alguien se ha dado cuenta”. Lo dice Fabio Chiusi en la introducción de la edición en español del informe Automating Society 2020, de Algorithm Watch, que se acaba de presentar. La edición en inglés, publicada en octubre, ofrece un detallado análisis de la implantación de sistemas automatizados de toma de decisiones (ADM) en 16 países europeos.

Leyendo el informe se comprueba que casi todos los países usan los sistemas automáticos para lo mismo, con ligeras variantes: gestión de subsidios, vigilancia predictiva, soporte judicial, evaluación educativa… Veamos algunos ejemplos.

Estonia: Se implanta un nuevo sistema para asignar subsidios familiares. El estado recopila y centraliza toda la información disponible sobre cada recién nacido y su familia. Los padres no necesitan solicitar las ayudas, las reciben directamente si tienen derecho a ellas.

Finlandia: La empresa japonesa Fujitsu ha automatizado la identificación de factores de riesgo de exclusión social en adultos jóvenes.

Francia: Extracción de datos de las redes sociales para detectar posibles fraudes fiscales.

Italia: Se hacen pruebas de “jurisprudencia predictiva“ para ayudar a los jueces a analizar resoluciones judiciales anteriores.

Dinamarca: El gobierno intentó monitorizar los ordenadores de los estudiantes durante los exámenes. La prueba provocó protestas masivas que obligaron a retirar temporalmente el sistema.

Alemania: Desde 2017, la Agencia Federal contra el Crimen utiliza la herramienta de evaluación de riesgos RADAR-iTE para clasificar a los “salafistas militantes” en tres niveles de amenaza (alto, conspicuo y moderado).

Gran Bretaña: “A la mierda el algoritmo” fue el grito unánime de las protestas estudiantiles del verano del 2020 tras conocerse los resultados de la evaluación de los alumnos de secundaria que había sido elaborada por un algoritmo. El remedio, que intentaba ser ecuánime en las valoraciones de un año atípico a causa de la pandemia, fue peor que la enfermedad. El resultado resultó discriminatorio e incomprensible.

.

.

España:

El sistema de ADM más avanzado es el protocolo VioGén, que evalúa el riesgo de que personas que han sufrido violencia doméstica vayan a ser atacadas nuevamente por su pareja o expareja. Cada vez que una mujer presenta una denuncia por violencia doméstica el agente que la atiende debe hacerle una serie de preguntas. Un algoritmo utiliza las respuestas para calcular el riesgo de que las mujeres sean atacadas nuevamente.

La Secretaría de Estado de Energía dispone de un software llamado BOSCO a disposición de las distribuidoras de electricidad. El objetivo es determinar si las personas tienen derecho a recibir ayuda para pagar sus facturas de electricidad. Civio, lobby ciudadano sin ánimo de lucro con sede en Madrid, descubrió que BOSCO niega sistemáticamente la ayuda a algunos solicitantes que cumplen todos los requisitos. La denuncia está en los tribunales.

El sistema Saler coteja información de distintas bases de datos de la Administración pública valenciana y del registro mercantil. Su finalidad es detectar comportamientos sospechosos (por ejemplo, una gran cantidad de pequeños contratos otorgados a la misma empresa). Ante una sospecha, Saler transmite automáticamente la información a la Agencia Antifraude, la Fiscalía o el Tribunal de Cuentas.

.

.

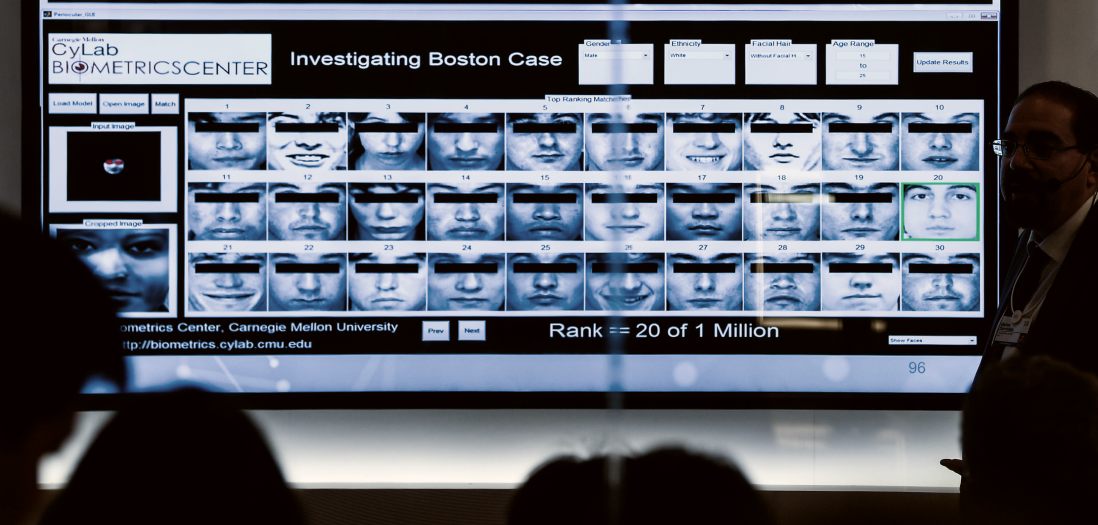

Auge de la vigilancia y el reconocimiento facial

En 2019, el informe de Algorithm Watch apenas mencionaba los sistemas de reconocimiento facial. “En poco más de un año, el reconocimiento facial está presente en escuelas, estadios, aeropuertos e incluso en casinos. También se utiliza para la vigilancia predictiva, para capturar a delincuentes, contra el racismo y, con respecto a la pandemia, para reforzar el distanciamiento social”, dice el informe.

Ejemplos:

Bélgica: Desde principios de 2019, el club de fútbol RWD Molenbeek ha estado experimentando en partidos de fútbol con software de reconocimiento facial. El sistema permite que las personas puedan entrar al estadio sin tener que mostrar sus entradas.

Polonia: El reconocimiento facial avanza en diversos ámbitos. Lo más innovador es el “análisis de sonrisas” que forma parte de un sistema de ADM probado en bancos: cuanto más sonríe un empleado, mejor es la recompensa.

Italia: Las tecnologías de reconocimiento facial se están implementando, o están a punto de implementarse, en los aeropuertos de Milán y Roma.

Se está analizando también un sistema de vigilancia de sonido en los estadios de fútbol como herramienta contra el racismo.

Alemania: La oficina Federal de Migración y Refugiados ha estado utilizando sistemas automatizados de reconocimiento de texto y voz para identificar a los refugiados.

La fuerte oposición pública detuvo la implantación en toda Alemania de un proyecto de reconocimiento facial que se había probado en la estación de Südkreuz, en Berlín.

.

.

España:

En noviembre de 2019, Ifema empezó a instalar cámaras de vigilancia con reconocimiento facial en el centro de conferencias de Madrid.

A finales de 2018, Marbella empezó a utilizar un sistema de videovigilancia de alta definición. Oficialmente, el sistema no incorpora reconocimiento facial, pero el software utilizado usa funciones como “búsqueda de apariencia” y “análisis facial”.

En 2016, la policía local de Rivas-Vaciamadrid puso en marcha una prueba piloto de Pred-Crime, un software desarrollado por la empresa española EuroCop. Pred-Crime analiza datos de antecedentes históricos para predecir dónde y cuándo es más probable que se cometan ciertos tipos de delitos como infracciones de tránsito y robos. En su web, EuroCop anuncia que entre sus clientes hay decenas de municipios de toda España.

.

Más riesgos que beneficios

Cada día se automatizan más ámbitos y, lo más relevante, se acelera la tendencia a dejar que sean las máquinas las que identifiquen, evalúen y tomen decisiones, actividades que hasta hace muy poco parecían reservadas al género humano.

Gracias a su capacidad de procesar ingentes cantidades de datos los sistemas automatizados pueden ser muy útiles, pero “en la práctica hemos encontrado muy pocos casos que demostraran de manera convincente un impacto tan positivo”, asegura el informe. Más aún, la mayor parte de las veces, “en lugar de ayudar a las personas, ponen en riesgo sus derechos.”

Se añade a todo ello la opacidad con la que están programados y la dificultad de acceder a los procesos que siguen.

Como dice Algorithm Watch, “cuando se promueven como “soluciones“, los sistemas de ADM viran inmediatamente hacia el territorio descrito en la tercera ley de Arthur C. Clarke: magia. Y es difícil, sino imposible, reglamentar la magia, y más aún dar transparencia y explicaciones en torno a ella. Uno puede ver la mano que se mete dentro del sombrero, y como resultado aparece un conejito, pero el proceso permanece en una caja negra“.

.

Relajación de la responsabilidad

¿Por qué entonces insistir y acelerar la automatización de una actividad tan propiamente humana que, por lo que parece, genera más riesgos que beneficios y que nos impide el acceso a entenderla?

La respuesta habrá que encontrarla probablemente en algún estudio socio-filosófico todavía por hacer, pero podríamos apuntar algunas ideas.

Viendo los ámbitos en los que los ADM ganan presencia (vigilancia, justicia y policía predictivas, gestión de ayudas, contratación laboral, evaluación educativa…) se puede deducir que estos sistemas son muy bien recibidos en ámbitos habitualmente saturados (concesión de subsidios, vigilancia, justicia…). Ante la dificultad y el coste de aumentar plantillas y la mayor eficiencia de los sistemas informatizados cuando hay que procesar muchas fuentes de datos y en unos plazos limitados la automatización se percibe como la solución.

Además, aunque los sistemas automatizados estén pensados inicialmente como un complemento para aliviar la carga de trabajo de las plantillas, ceder la responsabilidad de la toma de decisiones a una máquina resulta algo muy tentador, sobre todo en ámbitos de creciente complejidad y en los que la presión social hacia quien toma las decisiones es muy alta.

La fascinación por la magia tecnológica de la que hablaba Arthur C. Clarke contribuye a la relajación de la responsabilidad. La supuesta perfección de las máquinas nos invita a adaptarnos a ellas, a que sean ellas las que decidan y quitarnos así un peso de encima. Convenimos en adaptamos en vez de que sean los sistemas automatizados los que se adapten a los requisitos de la sociedad.

Pero como recuerda el informe, “los algoritmos no son ni neutrales ni objetivos, aunque tendemos a pensar que lo son. Replican las conjeturas y creencias de quienes deciden implementarlos y programarlos. Los seres humanos, por lo tanto, son, o deberían ser, responsables de las elecciones algorítmicas buenas y malas”.

Deciden las máquinas pero los responsables somos los humanos.

1 comments

Muchas gracias una vez más.

Una observación solamente: Las máquinas no son las que deciden. Lo hacen quienes las programan, las instalan y las usan para tomar o imponer sus decisiones.

Así y todo, creo que valdría la pena produndizar en la fascinación que nos producen las máquinas. También en por qué tendemos a aeptar pasivamente que se hayan convertido en un instrumento para quitarnos poder de decisión (y darlo a otros).

Muy cordialmente