Falla la confianza en los nuevos sistemas automatizados pero se asumen con una mezcla de entusiasmo y resignación

Hace unos días estuvo en Barcelona el psicólogo y neurocientífico norteamericano Gary Marcus, una de las voces más críticas con el desarrollo acelerado de la IA. En una conferencia ante parlamentarios europeos defendió una idea central: no podemos confiar en la IA generativa.

Expuso algunos ejemplos de los despropósitos de ChatGPT, el paradigma de la generación automatizada de texto:

- Errores: Según el chatbot un kilo de ladrillos pesan igual que dos kilos de paja. Aunque las reglas de ajedrez son delimitadas, a veces sugiere jugadas imposibles.

- Incapacidad de establecer correlaciones lógicas: Sabe identificar el nombre de la madre de Tom Cruise, pero si le preguntas cómo se llama el hijo de esa señora dice desconocerlo.

- Invenciones. Aunque todavía no hay sustituto del destituido speaker republicano Kevin McCarthy, la máquina insiste en que ya se ha elegido a Liz Cheney y se inventa incluso el resultado de la votación.

Los errores y «alucinaciones» no son exclusivos de ChatGPT sino de la propia arquitectura de los modelos de lenguaje (LLM) en que se basan. Afectan, por tanto, a todo tipo de generadores artificiales de textos, imágenes, audios…

- Sesgos. La reproducción de estereotipos de raza y género en imágenes y textos es constante: aunque los sitúes en África, la imagen de los médicos que genera la IA siempre corresponde a occidentales blancos que atienden a pacientes negros. Las profesiones de prestigio siempre son representadas por hombres; las tareas de asistencia, por mujeres…

Ante esa falta de fiabilidad, crece la preocupación por el entusiasmo y rapidez con la que se está desplegando la IA generativa, tanto en el ámbito empresarial como en el social y político.

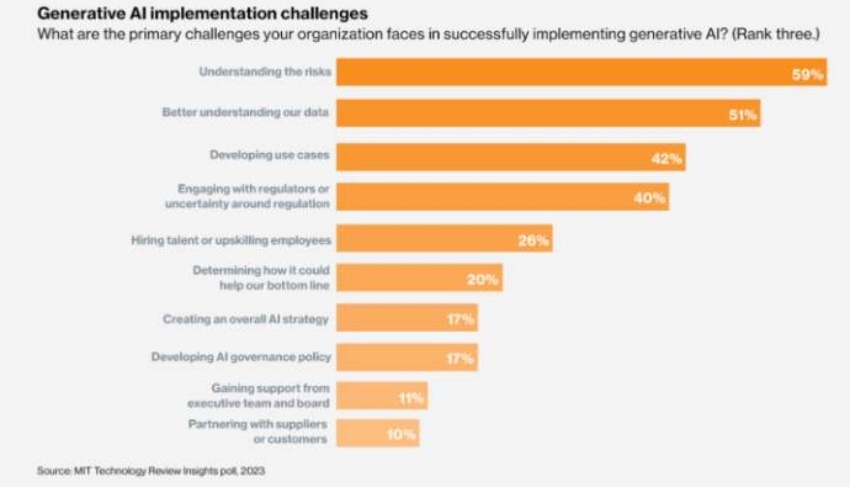

Un estudio que acaba de publicar el MIT concluye que el mayor recelo que tienen las empresas para incorporar soluciones de IA generativa es que no comprenden el riesgo real que conlleva su implementación. Casi un 60% de los empresarios consultados reconocen esa prevención.

En el ámbito social y político preocupa, sobre todo, que esta tecnología de rápida implantación y bajo control pueda multiplicar la ya de por sí desbocada generación de desinformaciones y manipulaciones que se difunden a través de las redes sociales.

Un reciente informe de Freedomhouse alerta que la IA generativa amplifica la desprotección de los derechos humanos:

- Más intoxicación. La IA generativa ya se ha utilizado en al menos 16 países para sembrar dudas, difamar a los oponentes o influir en el debate público.

- Más censura. Los gobiernos autoritarios técnicamente más avanzados del mundo intentan que las aplicaciones de IA refuercen sus sistemas de censura. Los marcos legales en al menos 22 países exigen que las plataformas digitales implementen técnicas de aprendizaje automático que impida el discurso político, social y religioso desfavorable.

Durante la campaña de las recientes elecciones en los estados alemanes de Baviera y Hesse y también en Suiza, la organización Algorithm Watch realizó un estudio sobre la fiabilidad de la información política que suministraba Bing Chat (la réplica de ChatGPT en Microsoft).

- Conclusión: Nadie debería utilizar chatbots para estar informado sobre elecciones políticas! Las respuestas de Bing Chat fueron en parte completamente incorrectas y en parte engañosas. Dado que los votantes que utilizan Bing Chat como fuente de información pueden ser inducidos a tomar decisiones equivocadas, sistemas como Bing Chat ponen en peligro la democracia y la formación de la opinión pública.

¿Por qué tanto entusiasmo?

Si genera tantos errores, sesgos, desinformaciones e intoxicación… ¿por qué seguimos tan fascinados por la IA generativa?

El estudio del MIT constata que, a pesar de sus recelos, el 96 por ciento de los empresarios encuestados están dispuestos a implantar estos sistemas. ¿Por qué tanta unanimidad si un 60 por ciento teme las consecuencias de implantarlos?

Hace unos meses algunas universidades y escuelas de todo el mundo restringieron el uso de ChatGPT. Ahora empiezan a reconsiderar su decisión. Australia ha levantado la restricción a partir de 2024. Las escuelas públicas de Nueva York lo hicieron en mayo. Universidades de prestigio como Harvard o Yale se limitan a recomendar unas pautas de uso. Si los chatbots cometen errores e inducen al fraude académico, ¿por qué aceptarlos?

En definitiva, si como dice Gary Marcus la IA no inspira confianza, ¿por qué asumimos su implantación?

Algunas respuestas

Se me ocurren algunas respuestas.

Fascinación. Desde el siglo XIX nuestra fascinación por los avances tecnológicos no para de aumentar. Cualquier invento es acogido con admiración, cualquier innovación que lleve el sello de la disrupción la asumimos con entusiasmo. La IA generativa, por su capacidad de llegar a mucha gente, está teniendo la misma acogida que hace unas décadas tuvo Internet, la telefonía móvil o las redes sociales.

Inevitabilidad. La fascinación viene acompañada por una sensación de inevitabilidad. Cuando un avance tecnológico irrumpe con tanta fuerza se asimila a un fenómeno natural al que el ser humano no puede oponerse. “No podemos evitar el futuro”, “si todos lo hacen, yo también debo hacerlo”, “más vale remar a favor del viento”, son frases que ilustran el comportamiento contemporáneo.

Competitividad. El despliegue de la IA contiene un mensaje implícito: será un factor determinante para la competitividad. La IA promete reducir los tiempos de producción, anticipar resultados y afinar previsiones, tomar decisiones con mayor elementos de juicio (datos) e incluso automatizarlas. Y, sobre todo, hacer lo mismo o más con menos recursos, léase trabajadores.

Empoderamiento. Al igual que ocurrió con la aparición de Internet, la IA generativa traslada la promesa de un empoderamiento general de la población. Podremos comunicarnos en muchos idiomas aunque no sepamos hablarlos. Podremos redactar correctamente aunque nos falle la gramática y el estilo. Podremos diseñar, pintar o ilustrar aunque no tengamos ninguna habilidad para ello… La IA se convierte en una varita mágica que nos confiere superpoderes.

Democratización. Gracias a ese supuesto empoderamiento y a pesar de los riesgos que comporta para la propagación de bulos, la IA generativa es percibida como un elemento democratizador. Es fácil comprobar lo sencillo que resulta escribir un trabajo académico. No lo es tanto darnos cuenta de que la IA está dominada por unos cuantos actores que controlan su producción y su evolución y ponen en jaque la siempre lenta respuesta de los poderes públicos.

Ilusión. Y de la combinación de todos estos factores surge quizás la razón más determinante. En un mundo deprimido y convulso por guerras inacabables, crisis migratorias, emergencia climática, auge del populismo y la crispación política, temor a las pandemias y gobiernos y familias endeudadas, de pronto surge una especie de milagro tecnológico que aporta la ilusión de que, a pesar de todo, seguimos avanzando.

Por eso estamos dispuestos a perdonarle sus defectos y alucinaciones.

2 comments

Excelente artículo Joan. Gracias

Muchas gracias, Eladio