Stephen Hawking desconcertó al mundo cuando en una entrevista concedida a la BBC en 2014 aseguró que el desarrollo avanzado de la Inteligencia Artificial podría significar el fin de la raza humana.

Que lo dijera un tecno-escéptico hubiera resultado anecdótico, aunque hace cuatro años pocas voces alertaban del riesgo de las máquinas autónomas. La IA estaba en una etapa más primaria que la actual.

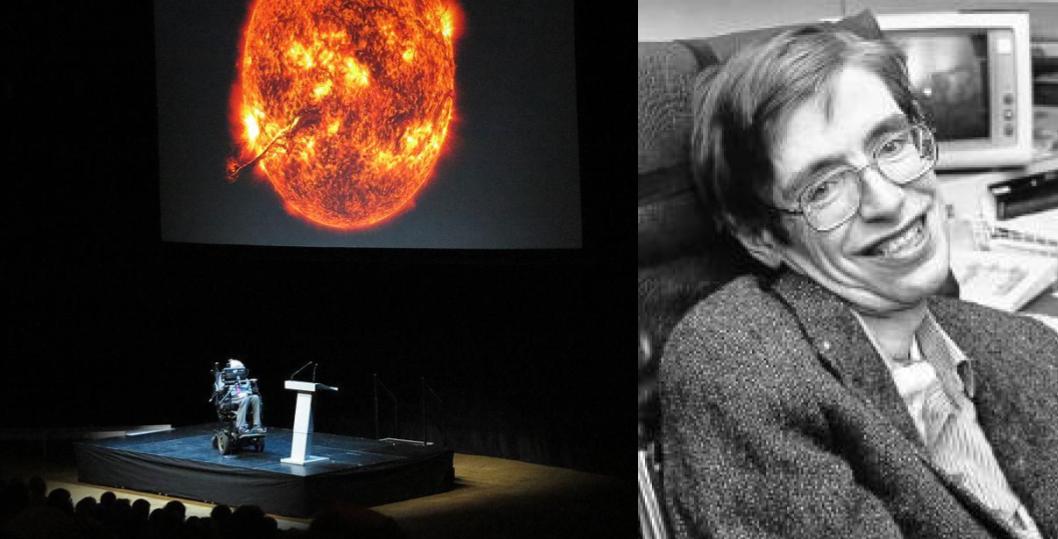

El desconcierto se generó porque lo decía un científico de primer orden mundial que debía su escasa movilidad y capacidad de comunicación a un artefacto robótico que autoaprende de su propio comportamiento. Nadie en el mundo vivió tan sujeto a la tecnología y el autoaprendizaje de las máquinas como el científico inglés. Nadie que conociera mejor sus ventajas podía alertar de sus peligros

En los últimos años de su vida Stephen Hawking utilizó un sistema de comunicación fabricado por Intel que incorporaba un sistema incipiente de Inteligencia Artificial desarrollado por la empresa inglesa Swifkey. Este sistema aprendía de las argumentaciones del científico y le proponía palabras y frases para agilizar su comunicación.

Durante casi veinte años, Hawking pudo usar un interruptor que hacía las veces de teclado, que unido a una voz sintética algo primitiva le permitía comunicarse precariamente. Cuando en 2005 la evolución de su enfermedad le impidió usar el pulsador, los programadores que le atendían desarrollaron un sistema de reconocimiento del movimiento de sus mejillas y de sus expresiones faciales. Unido a los avances en la predicción de texto, el nuevo software le permitió comunicarse a la velocidad con la que un adulto teclea un móvil.

Cuando parecía que su enfermedad degenerativa le condenaba a una vida casi vegetal, la tecnología facilitó que Stephen Hawking pudiera escribir la Breve Historia del Tiempo, el mayor best seller de divulgación científica que se haya publicado jamás.

Sin duda, Hawking es el científico (y probablemente el ser humano) con mayor experiencia directa de las bondades de la mecánica, la robótica y la inteligencia artificial.

Pero cuando el presentador de la BBC le preguntó sobre la modernización de la tecnología que utilizaba para comunicarse, Hawking lanzó su advertencia: las formas primitivas de inteligencia artificial desarrolladas hasta el momento habían demostrado ser muy útiles, pero temía las consecuencias de crear algo que pudiera igualar o superar a los humanos. “Despegaría por sí misma y se rediseñaría a un ritmo cada vez mayor“, dijo. “Los humanos, que están limitados por la lenta evolución biológica, no podrían competir y serían reemplazados”.

En octubre 2016, durante la inauguración del centro de inteligencia artificial de la Universidad de Cambridge (su propia universidad), amplió sus argumentos:

“Creo que no hay una gran diferencia entre lo que se puede lograr con un cerebro biológico y lo que se puede lograr con una computadora. Por lo tanto, las computadoras pueden, en teoría, emular la inteligencia humana y superarla. La inteligencia artificial está progresando rápidamente. Los hitos recientes, como los automóviles que conducen por sí mismos o una computadora que gana en el juego del Go, son signos de lo que está por venir. Enormes niveles de inversión se están vertiendo en esta tecnología. Los logros que hemos visto hasta ahora seguramente palidecerán ante lo que traerán las próximas décadas. Los beneficios potenciales de crear inteligencia son enormes. No podemos predecir lo que podríamos lograr cuando nuestras propias mentes sean amplificadas por la IA”

.”Tal vez con las herramientas de esta nueva revolución tecnológica, podremos deshacer parte del daño causado al mundo natural por la industrialización. Y seguramente apuntemos a erradicar finalmente la enfermedad y la pobreza. Todos los aspectos de nuestras vidas se transformarán. En resumen, el éxito en la creación de IA podría ser el evento más importante en la historia de nuestra civilización. Pero también podría ser el último, a menos que sepamos cómo evitar los riesgos. Además de beneficios, la IA también conlleva peligros, como poderosas armas autónomas, o nuevos procesos para que unos pocos puedan oprimir a la mayoría”

Hace unos meses, en noviembre de 2017, con motivo del número 100 de la revista Wired, Stephen Hawking perseveró en su visión:

“Me temo que la IA puede reemplazar a los humanos por completo. Si la gente diseña virus informáticos, alguien diseñará una IA que mejore y se replique a sí misma. Esta será una nueva forma de vida que supere a los humanos”.

¿Tenía razón Stephen Hawking? ¿Estamos realmente ante un riesgo tan grave? ¿Será tan estúpido el ser humano para crear un sistema tecnológico que aniquile su propia supervivencia? ¿Son tan ciegos los científicos como para poner en peligro a la humanidad?

Si nos fijamos en los avances científicos y sociales alcanzados a lo largo de los siglos deberíamos mostrarnos confiados, pero si atendemos a la capacidad de destrucción de los propios habitantes del planeta (erosión del medio ambiente, aumento de las desigualdades, incapacidad de atender a la desesperación de millones de seres humanos, insensibilidad ante los desfavorecidos, incremento del gasto militar…) la respuesta es inquietante.

Uno de los expertos españoles más reconocidos en el campo de la Inteligencia Artificial, Ramón López de Mantaras, se muestra bastante más esperanzado. En un reciente artículo publicado en el El Pais, decía:

“Tendemos a creer que la IA no tiene límites cuando de hecho es bastante limitada y, lo que es más importante, no tiene casi nada que ver con la inteligencia humana. Por muy sofisticada que sea la inteligencia artificial siempre será distinta de la humana, ya que el desarrollo mental que requiere toda inteligencia compleja depende de las interacciones con el entorno y estas interacciones dependen a su vez del cuerpo, en particular del sistema receptivo y del sistema motor”.

A criterio de López de Mantaras los verdaderos peligros ya están aquí y tienen que ver con la pérdida del control de la privacidad, la autonomía de los sistemas de contratación bursátiles, el desarrollo de las armas autónomas o el sesgo de los algoritmos. Por ejemplo.

Para poner en peligro el futuro de la humanidad no hacen falta robots. Nos bastamos nosotros.