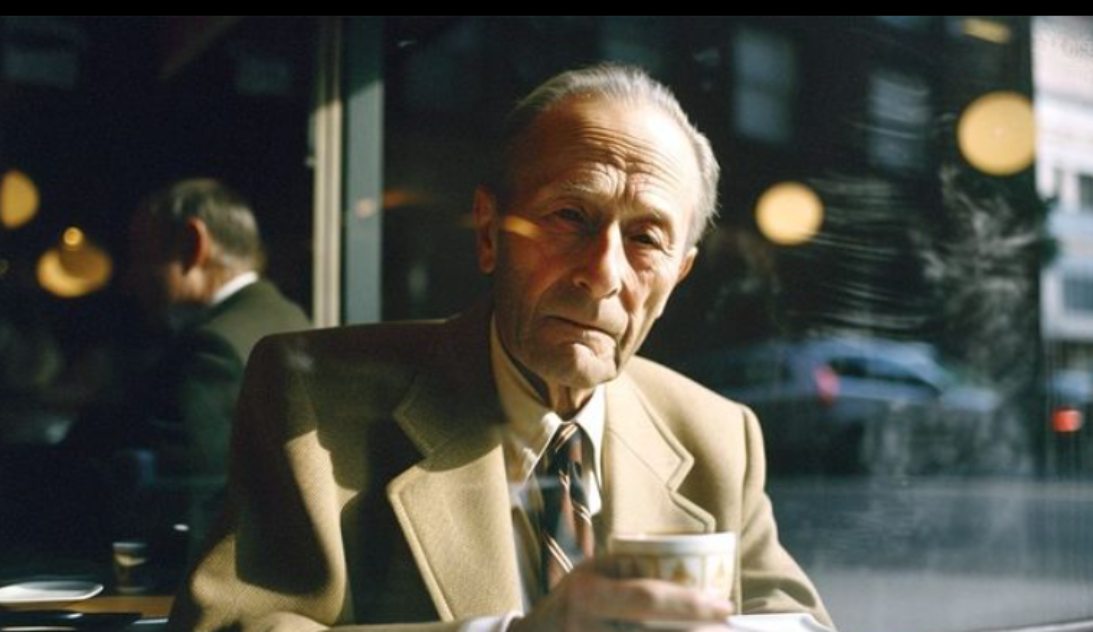

La IA generativa alcanza niveles de emulación fotográfica. La realidad se puede captar pero también se puede inventar. ¿Estamos preparados para desconfiar de lo que ven nuestros ojos?

La imagen que encabeza este artículo la ha generado un sistema de inteligencia artificial. A estas alturas, eso no debería sorprendernos. La IA generativa evoluciona tan deprisa que cada semana se baten estándares de calidad hasta hace poco impensables. La versión 5 del programa Midjourney con el que la diseñadora Julie Wieland ha creado la imagen permite generar rostros aparentemente perfectos envueltos en transparencias y efectos fotográficos de alta calidad y cuidada iluminación. Sin cámaras. Sólo hace falta un ordenador y acertar con las indicaciones de texto que requiere el programa.

Una imagen así no puede sorprendernos pero debería preocuparnos. Al alcanzar el nivel de emulación fotográfica, la IA nos tienta a no tener que recurrir a la fotografía para captar la realidad. De hecho, con la IA no hace falta captarla, la podemos inventar. La fotografía pierde su sello de garantía testimonial.

Hace unos días, un fotógrafo comentaba que se había pasado el fin de semana manipulando programas de inteligencia artificial hasta que le salieron unas dramáticas imágenes de la guerra de Ucrania. Las envió a unos cuantos amigos, todos le respondieron con elogios y hasta le preguntaron por su experiencia en el campo de batalla.

Poco a poco vamos aprendiendo a desconfiar de lo que leemos, sobre todo en las redes sociales. Circula tanta mentira escrita que nos ponemos en guardia ante cualquier texto que nos sorprenda. Ante la sospecha, buscamos (no siempre, no todos) la garantía de algún medio solvente o de alguna imagen que corrobore lo que estamos leyendo. Desconfiamos de las palabras pero no estamos preparados para desconfiar de lo que ven nuestros ojos.

Ver para sospechar

En 1843, justo cuando la fotografía iniciaba sus primeros pasos, el filósofo alemán Ludwig Feuerbach decía que “nuestra era prefiere la imagen a la cosa, la copia al original, la representación a la realidad, la apariencia al ser”. Desde entonces ha llovido mucho (últimamente más bien poco) pero el valor de la imagen no ha hecho más que aumentar.

La fotógrafa y escritora Susan Sontag añadía:

“Una sociedad llega a ser moderna cuando una de sus actividades principales es producir y consumir imágenes, cuando las imágenes ejercen poderes extraordinarios en la determinación de lo que exigimos a la realidad y son en sí mismas ansiados sustitutos de las experiencias de primera mano, se hacen indispensables para la salud de la economía, la estabilidad de la política y la búsqueda la felicidad privada.” (Sobre la fotografía, 1973)

En las últimas décadas le hemos dado una vuelta de tuerca a la modernización y delante de nuestros ojos hemos colocado pantallas para que intermedien con la realidad ¿Qué porcentaje de rostros, objetos o paisajes vemos directamente y cúantos a través de alguna pantalla? Consumimos unas 4 horas diarias de televisión, la jornada laboral de muchos oficios transcurre ante monitores, el entretenimiento se focaliza en los móviles… Alguien podría echar las cuentas.

Hemos delegado la visión de la realidad a la representación que de ella hacen las imágenes. Si esta representación se altera, si lo que ven nuestros ojos no se corresponde con aquello que realmente es, nuestra comprensión de la realidad se descompone. Una imagen aporta legitimidad. Nuestras mentes están preparadas para confiar en nuestros ojos aunque lo que vean sea la representación del instante que captó una máquina fotográfica. No estamos preparados para tener que desconfiar también de lo que vemos.

Ver para creer, decía el refrán. Ya no sirve. Habrá que inventar nuevos dichos: ver para sospechar, ver para desconfiar, ver para no creer. No va a ser fácil acostumbrarnos a un mundo así, y sobre todo, no va a ser agradable.

Falsear la historia

Últimamente a la gente le ha dado por falsear imágenes del Papa. Con abrigos acolchados, saludando a un sacerdote satánico… En esa carrera desenfrenada por generarlo todo, nada ni nadie está a salvo. También la historia sufre los efectos de nuevos mecanismos que contribuyen a tergiversarla.

La cuenta de Reddit de Midjourney está repleta de imágenes que muestran supuestos acontecimientos históricos como «El infame incidente de la peste azul» en la Unión Soviética en la década de 1970 o la «supertormenta solar y el apagón de julio de 2012» en los EEUU. Todas las imágenes las ha generado una IA y ninguno de estos sucesos ocurrió jamás.

En otra publicación, un collage de cuatro imágenes generadas por IA “demostraba” cómo se había inventado la llegada del hombre a la Luna («Escenificación del alunizaje, 1969»). Las imágenes, con la calidad granulada propia de las fotos de finales de los años 60, muestran un equipo de producción filmando el falso alunizaje.

Se nos viene encima una tormenta de gran magnitud pero todavía falta que llegue el ojo del huracán: los videos hiperrealistas de generación instantánea.

Los llamados deepfakes proliferan en la red desde hace años: Obama diciendo cosas que no ha dicho, celebridades que se confunden con actrices porno… pero en todos ellos hay algo que no encaja. Son rudimentarios, se les adivina el rastro de la manipulación. Cuando la tecnología perfeccione sus procesos y logre los resultados que está alcanzando con la emulación fotográfica, los gatos se convertirán en liebres ante nuestros ojos y no nos daremos cuenta. Con la llegada anunciada de los deepfakes hiperrealistas generados por IA nuestros ojos pueden mentirnos mucho más.

Venenos y antídotos

Hace unos días la revista Xataka proponía un juego con 20 imágenes en el que había que distinguir cuáles eran tomadas por fotógrafos y cuáles, generadas por máquinas. Había 10 de cada. Mirándolas con detenimiento se pueden adivinar, pero tiene su dificultad. En cuestión de semanas serán indetectables a simple vista.

Para impedir que la tormenta acabe en inundación, investigadores y empresas tratan de encontrar un antídoto que nos alerte cuando una imagen ha sido generada por una máquina.

Air or not es una aplicación que asegura detectar imágenes creadas por inteligencia artificial con un 95 por ciento de precisión.

Intel dispone de FakeCatcher una tecnología que, según dice, puede detectar videos falsos en tiempo real con una tasa de precisión del 96%. Lo hace evaluando lo que nos hace humanos: un sutil «flujo sanguíneo» en los píxeles de un video. Cuando nuestros corazones bombean sangre, nuestras venas cambian de color. Estas señales del flujo sanguíneo se reflejan en la cara y los algoritmos lo detectan.

Si hoy ya resulta imprescindible equipar nuestros dispositivos con antivirus pronto lo será también equipar nuestra mirada con detectores de falsificaciones. Además de gafas de realidad aumentada tal vez habrá que inventar gafas de realidad verificada.

Así, a base de venenos y antídotos avanza la mejor de nuestra tecnología. Ver para creer.